2026年春招,蚂蚁集团、Meta、Canva、Shopify等全球头部企业,已不约而同地在招聘中引入AI能力考核,要求候选人使用AI工具完成任务,重点评估的不只是专业能力,更是“带着AI能交付什么质量的成果”。

全球头部企业已统一行动,招聘环节必须考核候选人的AI实战能力。

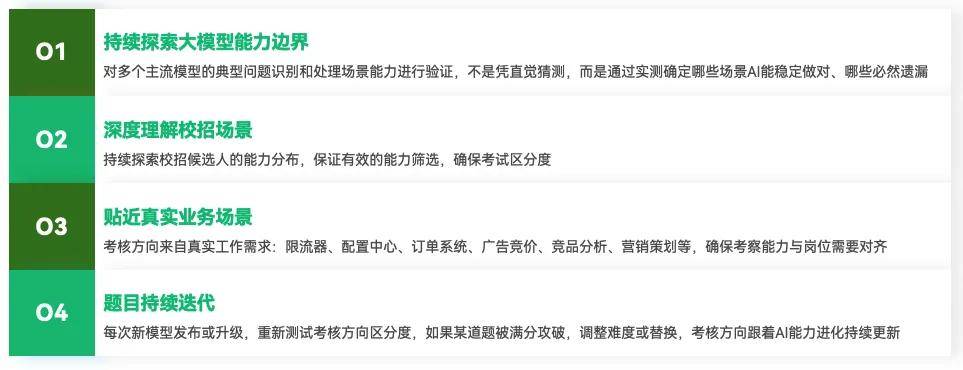

牛客AI能力全新考核方式即将上线!这是牛客基于企业对AI时代人才需求的全面洞察后,推出的覆盖多岗位的AI能力考核产品,针对AI的能力边界设计考察场景,直接度量人+AI的交付能力,致力于打造业界领先的AI人才评估体系,为先进组织AI转型提供人才保障。

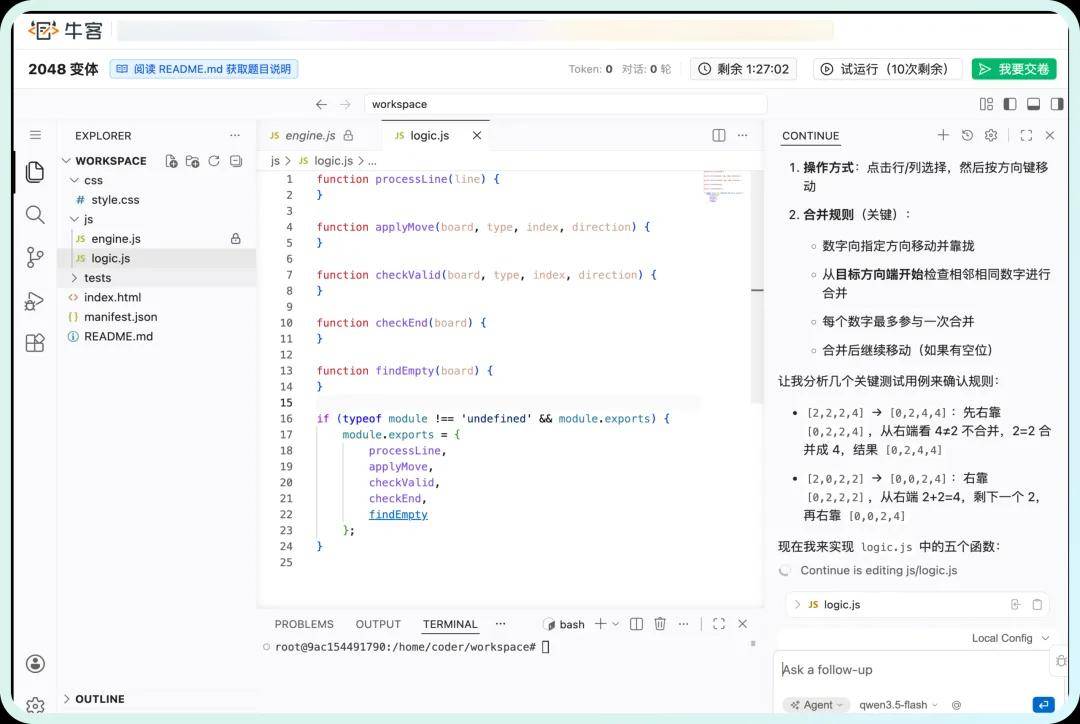

图 牛客AI实战demo演示

图 牛客AI实战demo演示

01.为什么需要考核候选人AI应用能力?

AI时代,大模型正在改变每一个岗位的工作方式。工程师用Agent写代码,产品经理用AI辅助需求分析,运营人员用AI生成内容和处理需求,市场同学用AI策划活动、做竞品分析……毕马威调研报告显示,中国AI采用率高达93%,远高于全球平均水平,半数的中国职场人已将AI工具纳入日常工作。工作方式变了,企业对人才的能力要求及评估方式也需要跟上。

今天,企业需要的人才,不仅需要具备扎实的专业基础,还要能够熟练运用AI工具高质量地完成工作,这导致HR在招聘环节面临着现实挑战:人才竞争越来越激烈,谁能真的用好AI、谁能真的满足业务部门的需求,从简历和传统考试中很难判断。

针对此,牛客AI能力考核致力于帮助HR在招聘前端就把候选人的AI应用能力看清楚,实现AI时代人才的能力精准评估。

02.多维度、更全面,三大考核方向精准筛选

深耕科技人才评估12年,牛客服务了数千家企业、上千万场笔面试,基于对科技人才能力模型的长期追踪与洞察,将AI应用能力拆解为人机协作、专业度、AI认知、AI思维四大维度,并对应设计AI常识考核、AI提示词能力考核、AI实战能力考核,企业可根据不同岗位的能力要求,灵活组合考核方向和分值比例,实现“一岗一方案”的精准评估。

AI常识考核:快速评估AI基础知识与概念理解

对候选人的AI常识进行考核是整套考核体系的基础筛选过程,快速了解候选人对AI的认知程度,覆盖AI基础概念、技术原理、应用场景、伦理与安全等维度,标准化客观评分,适合大规模基础能力摸底。

AI提示词能力考核:考察精准控制AI输出的能力

给AI一条好的指令和给团队成员交代一个任务,本质上是同一种能力——把模糊的目标拆解为精确的执行步骤。这不只是技术能力,是AI时代所有岗位都需要的底层素质。

牛客独创提示词考察方案,主要考核候选人能不能够写出一条足够精准的指令,让AI稳定、准确地完成一个特定任务。候选人根据任务要求编写Prompt,可反复调试,模拟真实工作中的迭代优化过程,提交后系统在后台自动运行5-10个隐藏测试用例,考察候选人的指令设计能力。

该考核方向的任务场景涵盖多岗位,如技术岗的代码审查与调试、产品岗的CRM信息提取与需求拆解、运营岗的营销文案生成与用户反馈分类等,系统从准确性、鲁棒性、边界处理三个核心维度综合考量候选人的能力。

AI实战能力考核:让候选人在AI辅助环境下完成真实任务

AI实战能力考核是面向企业全岗位的核心考察模块,覆盖多样化工作场景,如:

●工程师岗位与AI协作完成从需求拆解、接口设计到代码实现的开发交付

●产品经理岗位与AI协作完成从业务目标到流程设计、页面原型的方案输出

●数据分析岗位与AI协作完成指标口径定义、数据处理、归因分析与结论输出

●活动营销岗位与AI协作完成主题设计、传播内容与渠道节奏规划、预算与ROI测算等可执行的活动方案

候选人需要在集成AI助手的环境中,完成贴近真实工作场景的任务,全面考核候选人驾驭AI工具的能力。

除了以上三大核心考核方向,牛客也将自然语言问答、智能追问等考核形式融入企业对候选人AI能力考核方案中,无缝衔接牛客AI面试,对候选人的逻辑表达、专业判断、应变能力等进行评分,做出一致性判断。

03.系统化、可量化,直接度量“人+AI”的交付能力

牛客AI能力考核在传统笔试考核“专业能力”的基础上,增加对候选人“使用AI能交付什么质量的成果”的考核,二者结合,通过系统化、可量化的评估方案,为企业筛选出最合适的人才。

1、分层分类:深谙岗位,精准命题

牛客深度拆解工程师、产品经理、运营、市场营销等企业核心岗位的真实业务场景与能力基线,从岗位胜任力倒推必须掌握的知识点,将考核逻辑、难度梯度与评分权重根植于日常AI协作的关键任务,确保考核内容就是岗位日常工作的内容,让候选人在考核过程中展示出实战上手能力。

企业可灵活组合考核方向与分值,考核信效度更高,对业务场景的理解更透彻。

2、考核方向更科学:从认知到实战,全链路评估AI交付能力

给AI一条好的指令和给团队成员交代一个任务,本质上是同一种能力——把模糊的目标拆解为精确的执行步骤。这不只是技术能力,是AI时代所有岗位都需要的底层素质。比如技术岗的代码审查与调试、产品岗的CRM信息提取与需求拆解、运营岗的营销文案生成与用户反馈分类等。

牛客独创提示词考察方案,主要考核候选人能不能够写出一条足够精准的指令,让AI稳定、准确地完成一个特定任务。候选人根据任务要求编写Prompt,可反复调试,模拟真实工作中的迭代优化过程,提交后系统在后台自动运行5-10个隐藏测试用例,考察候选人的指令设计能力。

3、自动化评分:行业独有,客观+智能双引擎

目前市面上关于AI能力的考核方式大多依赖大模型对候选人回答的理解来打分,同样的方案换一种说法可能得分就不一样,评分逻辑是黑盒,HR没法向候选人解释你为什么得了这个分数。

牛客的评分机制彻底颠覆这个现状,语义匹配和运行预设测试用例即时出分,不仅可以有效降低人才评估成本,更在一致性、可解释性与出分时效性上建立了领先优势。

4、标准统一:可量化、可对比、可追溯

消除人工评审的主观偏差,建立可横向对比的人才评估基准。

每次提交的测试结果、与AI的每一轮对话内容、Token消耗量、迭代修复路径全部留存,这些过程数据比分数更能说明候选人的真实能力。

当候选人提交失败时,系统只提示方向不给答案(如“注意超时后的处理”),候选人能不能从方向性线索里定位到具体问题,就是区分度所在。

2026年,AI工具面临的已经不是“要不要用”的问题,而是“会不会用”的问题。这意味着,求职者应更早地适应“AI辅助”的工作模式,提升专业能力的同时,也要练习如何高效地与AI协作;企业HR或面试官,应认真考虑在招聘流程中引入AI应用能力评估。

对企业来说,引入AI应用能力考核的价值很直接。在招聘前端就能看清候选人的AI实战水平,降低用人风险;同时补齐传统考核覆盖不到的能力维度,让企业对候选人的了解从一个分数变成一张完整的能力画像。与此同时,全自动评分即时出结果,HR和面试官可以从评审环节释放出来,尤其是在国内AI能力评估处于早期阶段的当下,率先建立这套体系的企业,也在向候选人传递一个明确的信号:我们走在行业前列,重视AI能力,重视善于使用AI的人才。

当行业标准建立起来的时候,没有跟上的企业会在人才竞争中处于被动。

免责声明:本站转载的文章,版权归原作者所有;旨在传递信息,不代表本站的观点和立场。