现如今,越来越多企业开始使用Agent来接待用户,Agent也逐渐成为企业的AI员工。在这种情况下,一个现实问题随之出现:我们该如何衡量Agent的工作情况,以及它的整体表现?

就像管理一名普通员工一样,我们既需要发现Agent在工作中的问题,也需要找到这些问题背后的原因,帮助它持续改进。

因此,对Agent进行质检,几乎成为一件不可避免的事情。

但在最近的交流中(包含天润融通在多个行业项目中的一线实践),我们发现很多团队对Agent的质检仍然缺乏经验,评估方式依旧停留在“工具阶段”,比如命中率、召回率、是否答对等指标。这些指标在测试环境中或许有效,却很难回答真实业务里最重要的那个问题——客户的这次问题,到底有没有被解决。

基于这一背景,本文将结合标杆客户的实践(含天润融通 ZENAVA 智能体平台的落地经验),探讨企业应当如何对Agent进行质检。

传统指标,为什么不再够用?

在实际落地中,很多团队对Agent的质检,依然停留在一组熟悉的技术指标上:命中率、召回率、是否答对。

这些指标并非没有价值,它们可以帮助判断Agent是否按预期调用了知识、执行了规则。但它们只能回答一个问题——系统有没有正常工作。

真正的问题在于,这些指标无法反映Agent在真实对话中的工作结果。

一次回答即使“技术上正确”,也可能因为理解偏差、表达方式或上下文判断失误,导致客户的问题并未得到解决。当质检只关注指标是否达标,而不关注结果是否闭环时,评估本身就会与真实业务产生偏差。

因此,如果质检仍然停留在“答得对不对”这一层面,那么Agent永远只能被当作工具来评估,而无法被当作一名需要对工作结果负责的员工。

四层质检体系:从风险控制到结果闭环

1、第一层:系统全量质检,看Agent有没有触碰“绝对不能错”的底线?

这一层质检关注的不是效果,而是风险。

在实际运行中,需要对Agent的全部会话进行100%全量检测,重点识别高风险指令和紧急业务场景,比如客诉赔付、时间承诺、人员安排承诺、工单处理进度承诺等,一旦触及不可接受的错误类型,能够被第一时间发现并处理。

这一层质检的作用非常明确:为Agent划清安全边界。它并不试图判断Agent表现得好不好,只负责确保一件事——不会出大事。

2、第二层质检:Agent核查Agent,看问题是否真的被解决。

仅仅不出错,并不等于把工作做好。因此,第二层质检的关注点,从“合规”转向“结果”。

这类能力在天润融通 ZENAVA 智能体平台的实践中已被验证:通过引入另一个Agent,对已完成的会话进行判断,重点关注对话中的关键信号:客户是否反复表达同一诉求,是否出现明显的负面情绪,是否陷入无效往返。

这一层质检不再纠结回答是否“正确”,而是判断一件更重要的事:客户的问题有没有被闭环解决。

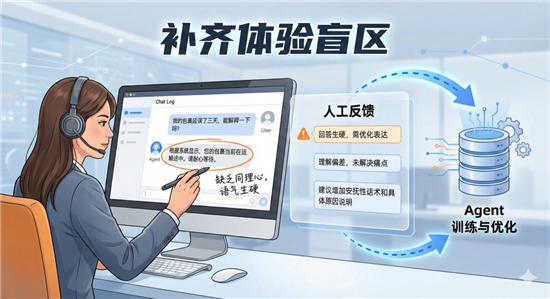

3、第三层质检:人工反馈,系统看不到的体验问题,让人来发现。

即便引入多层自动判断,仍然会有一类问题无法被系统准确识别——体验问题。

在真实使用中,一线客服人员往往最清楚哪些回答“看起来没错”,但在实际沟通中并不让人信任、理解或接受。因此,通过持续的人工反馈机制,这些真实使用感受才能被记录下来,并反向用于优化Agent的表现。

这一层质检的价值在于:补齐系统指标无法覆盖的体验盲区。

4、第四层质检:客户满意度才是最终裁判。

无论前面设置了多少内部指标,最终都必须回到一个问题:客户是否认可这次服务。

满意度并不是为了让数据好看,而是作为对前面所有质检结果的最终校验。只有当Agent真正解决了客户的问题,客户才会给出正向反馈。

在这一层,评判权不再掌握在系统或团队手中,而是交还给真实的业务对象。

过去,我们只会让客户对人工客服进行满意度评价,而很少让客户评价机器人。一个重要原因在于,我们默认机器人的服务体验有限,客户的满意度也不会太高。

但在实际运行中,这一判断正在被不断修正。过去一年里,越来越多客户开始在对话中主动向Agent表达感谢,这本身就是体验改善的直接信号。

随着客户对Agent的认可度不断提升,引入满意度评价,也逐渐成为把Agent当作“员工”来管理的重要一步。

免责声明:本站转载的文章,版权归原作者所有;旨在传递信息,不代表本站的观点和立场。